Page 35 - 2025年第56卷第2期

P. 35

分析结果在文中不再详述。因此,IWOA的收敛性能、寻优性能及稳定性均优于 WOA。

3.2 特征参量评价准则 IWOA的个体适应度函数需要有效表征特征子集的优劣程度,下面研究其构建方

[24]

法。层次聚类( HierarchicalClustering,HC) 是一种无监督学习算法,在没有先验知识的情况下,依据相

似性原则对研究对象进行分类。本文以 HC对振动信号的辨识准确率作为特征子集优劣程度的判别准则。

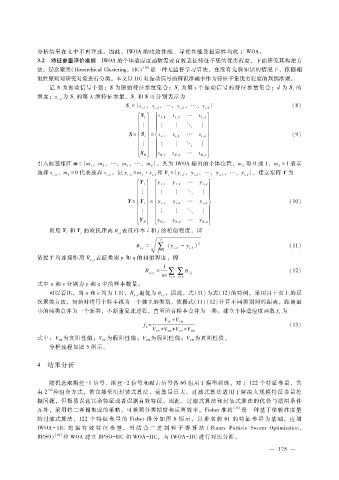

记 N为振动信号个数;S为原始特征参量集合;S 为第 i个振动信号的特征参量集合;d为 S 的

i i

维度;s 为 S 的第 λ维特征参量。S 和 S可分别表示为

i, λ i i

S= {s ,s ,…,s ,…,s } (8)

i

i,d

i,2

i,1

i, λ

S 1 s s … s

1,2

1,1

1,d

S = S = s s … s (9)

i

i,1

i,2

i,d

S s s … s

N N,1 N,2 N,d

引入标签矩阵 m= {m ,m ,…,m ,…,m },其为 IWOA输出的个体位置,m 取 0或 1,m = 1表示

λ

λ

λ

d

1

2

选择 s ,m = 0 代表放弃 s 。记 y = m ·s 和 Y= {y ,y ,…,y ,…,y },建立矩阵 Y为

i, λ λ i, λ i, λ λ i, λ i i,1 i,2 i, λ i,d

Y y y … y

1 1,1 1,2 1,d

Y = Y = y y i,2 … y (10)

i

i,d

i,1

Y y y … y

N N,1 N,2 N,d

表征样本 i和 j的相似程度,即

利用 Y 和 Y 的欧氏距离 θ i,j

i j

d

= ∑ (y -y ) 2 (11)

槡

θ i,j i, λ j, λ

λ=1

依据平均连接距离 R 表征类别 p和 q的相似程度,即

p,q

1

R = ∑∑ (12)

p,q θ i,j

ue i ∈p j ∈q

式中 u和 e分别为 p和 q中的样本数量。

,因此,式(11)为式(12)的特例。采用自下而上的层

p,q

可以看出,当 u和 e均为 1时,R 退化为 θ i,j

次聚类方法,初始时将每个样本视为一个独立的类别,依据式(11)(12)计算不同类别间的距离,距离最

小的两类合并为一个新类,不断重复此过程,直至所有样本合并为一类。建立个体适应度函数 f为

v

V + V TN

TP

f = (13)

v

V + V + V + V FN

FP

TN

TP

式中:V 为真阳性值;V 为假阳性值;V 为假阴性值;V 为真阴性值。

TN

FP

FN

TP

分析流程如图 5所示。

4 结果分析

随机选取断丝- 1 信号、断丝- 2 信号和敲击信号各 60组用于模型训练,对于 122个特征参量,共

122

有 2 种组合方式,若直接采用封装式算法,运算量巨大。过滤式算法适用于解决大规模特征参量挖

掘问题,但极易误选冗余特征或者误删有效特征,因此,过滤式算法和封装式算法的优势与适用条件

互补,采用将二者相集成的策略,可兼顾分类精度和运算效率。Fisher准则 [25] 是一种基于依赖性度量

的过滤式算法,122个 特 征 参 量 的 Fisher得 分 如 图 6所 示,以 排 名 前 61的 特 征 参 量 为 基 础,应 用

IWOA - HC 挖 掘 有 效 特 征 参 量, 另 结 合 二 进 制 粒 子 群 算 法 (BinaryParticleSwarm Optimization,

BPSO) [26] 和 WOA建立 BPSO - HC和 WOA - HC,与 IWOA - HC进行对比分析。

— 1 7 5 —