Page 54 - 2023年第54卷第7期

P. 54

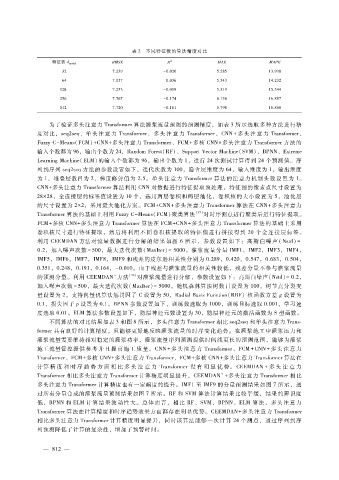

表 2 不同特征数的算法精度对比

RMSE 2 MAE MAPE

特征数 d model R

32 7.239 - 0.020 5.285 13.938

64 7.037 0.036 5.343 14.232

128 7.233 - 0.019 5.519 15.544

256 7.767 - 0.174 6.136 16.887

512 7.720 - 0.161 5.798 16.868

为了验证多头注意力 Transformer算法灌浆流量预测的预测精度,如表 3所示选取多种方法进行精

度对比,seq2seq、单头注 意力 Transformer、多 头 注 意 力 Transformer、CNN + 多 头 注 意 力 Transformer、

FuzzyC - Means(FCM) + CNN + 多头注意力 Transformer、FCM+ 多核 CNN + 多头注意力 Transformer方法的

输入个数都为 96,输出个数为 24,Random Forest(RF)、SupportVectorMachine(SVM)、BPNN、Extreme

LearningMachine (ELM)的输入个数都为 96,输出个数为 1,进行 24次测试计算得到 24个预测值。序

列到序列 seq2seq方法的参数设置如下,迭代次数为 100,隐含层维度为 64,输入维度为 1,输出维度

为 1,堆叠层数目为 2,梯度修剪值为 2.5。单头注意力 Transformer算法的注意力机制头数设置为 1。

CNN + 多头注意力 Transformer算法利用 CNN对数据进行特征提取预处理,特征图的像素点尺寸设置为

28 × 28,全连接层的标签值设置为 10个,选用两层卷积和两层池化,卷积核的大小设置为 5,池化层

的尺寸设置为 2 × 2,采用最大池化方案。FCM+ CNN + 多头注意力 Transformer算法在 CNN + 多头注意力

Transformer算法的基础上利用 FuzzyC - Means(FCM)聚类算法 [35] 对时序测点进行聚类后进行特征提取。

FCM+ 多核 CNN + 多头注意力 Transformer算法在 FCM+ CNN + 多头注意力 Transformer算法的基础上采用

卷积核尺寸进行特征提取,然后将利用不同卷积核提取的特征值进行拼接得到 20个全连接层标签。

利用 CEEMDAN方法对流量数据进行分解的结果如图 6所示,参数设置如下:高斯白噪声(Nstd) =

0.2,加入噪声次数 = 500 ,最大迭代次数(MaxIter) =5000 。灌浆流量分量 IMF1,IMF2,IMF3,IMF4,

IMF5,IMF6,IMF7,IMF8,IMF9和残差的皮尔逊相关性分别为 0.289,0.420,0.547,0.683,0.504,

0.351,0.248,0.191,0.164,- 0.010。由于残差与灌浆流量的相关性较低,残差分量不参与灌浆流量

的预测分量。利用 CEEMDAN’方法 [36] 对灌浆流量进行分解,参数设置如下:高斯白噪声(Nstd) =0.2,

加入噪声次数 = 500 ,最大迭代次数(MaxIter) =5000 。随机森林算法树数目设置为 100,树节点分裂变

量设置为 2。支持向量机算法惩罚因子 C设置为 50,RadialBasisFunction(RBF)核函数方差 g设置为

0.1,损失因子 p设置为 0.1。BPNN参数设置如下,训练数选取为 1000,训练目标选取 0.001,学习速

度选取 0.01。ELM算法参数设置如下,隐层神经元数设置为 30,隐层神经元的激活函数为 S型函数。

不同算法的对比结果如表 3和图 8所示,多头注意力 Transformer相比 seq2seq和单头注意力 Trans

former 具有良好的计算精度,且能够更好地反映灌浆流量的时序变化趋势。在灌浆施工中灌浆压力和

灌浆流量需要维持相对稳定的灌浆功率,灌浆流量序列预测提供时间线更长的预测范围,能够为灌浆

施工流量管控提供参 考并 且提高 施工 质量。CNN + 多头 注 意力 Transformer、FCM+ CNN + 多 头 注意力

Transformer、FCM+ 多核 CNN + 多头注意力 Transformer、FCM+ 多核 CNN + 多头注意力 Transformer算法在

计算 精 度 和 时 序 趋 势 方 面 相 比 多 头 注 意 力 Transformer没 有 明 显 优 势。 CEEMDAN+ 多 头 注 意 力

Transformer相比多头注意力 Transformer计算精度明显提升,CEEMDAN’ + 多头注意力 Transformer相比

多头注意力 Transformer计算精度也有一定幅度的提升。IMF1至 IMF9的分量预测结果如图 7所示,通

过所有分量合成的灌浆流量预测结果如图 7所示。RF和 SVM算法计算结果比较平缓,结果的辨识度

低,BPNN和 ELM计算结果波动性大。总体而言,相比 RF、SVM、BPNN、ELM 算法,多头注意力

Transformer算法在计算精度和时序趋势效果方面都存在明显优势。CEEMDAN + 多头注意力 Transformer

相比多头注意力 Transformer计算精度明显提升,同时该算法能够一次计算 24个测点,通过序列到序

列预测降低了计算的复杂性,增加了预警时间。

— 8 1 —

2