Page 122 - 2023年第54卷第4期

P. 122

型易因自身局限性影响预测模型的精度与稳定性 [13] ,所以多因子融合在大坝变形预测中的应用有待

研究。

回归算法的非线性信息挖掘和建模预测能力同样影响预测模型的表现 [14] 。多元线性回归(Multiple

LinearRegression ,MLR) [15] 方法因简单易行等优点在大坝安全监控领域得到广泛应用,但其难以处理

变量间的非线性关系,易影响模型的预测精度与稳定性。随着人工智能与机器学习的进步,随机森林

( Random Forest,RF) [16] 、支持向量机(SupportVectorMachine,SVM) [17] 等机器学习算法也取得了优

异的表现。众多研究表明 [18 - 20] ,机器学习算法具有强大的信息挖掘能力和较高的预测精度,但是算法

表现受参数选取影响较大,可解释性差。

变形预测模型在建立时存在很大的假设空间,使用单一算法可能因随机性导致模型泛化性能不

佳,降低预测的准确性和稳定性。Stacking集成学习通过集成多异算法及二次学习,可以有效提升模

型的泛化能力。该算法的基本思想是选择相异算法作为基学习器进行预测,并通过元学习器集成基学

习器的预测结果,得到最终预测值 [21] 。秦胜伍等 [22] 采用 Stacking集成学习构建了多模型融合的基坑

地面沉降变形预测模型,并结合实际工程验证了其有效性。Lei等 [23] 采用主成分分析和随机森林进行

环境特征选择,构建了基于 Stacking集成学习的大坝变形动态监测模型。上述成果推动了 Stacking集

成学习在变形预测领域的研究,但其着重于对算法的集成,而未顾及到 Stacking算法对多个特征因子

模型的融合。

针对单一因子、算法存在自身局限性和单因子、单算法预测模型泛化能力不足等问题,本文基于

多因子融合和 Stacking集成学习思想,构建了泛化性强、鲁棒性高的大坝变形组合预测模型,主要内

容如下:(1)基于解释因子模型(HST、HTT、HTT)和回归算法(MLR、RF、SVM)建立多种单因子单

A

算法预测模型,探究各模型预测性能差异;( 2)基于 Stacking集成学习,通过高斯过程回归(Gaussian

ProcessRegression,GPR)先后对回归算法与解释因子进行集成,建立多因子、多算法融合的大坝变形

组合预测模型;( 3)以某混凝土拱坝为例,通过多模型构建与性能比较,验证本文所提出模型的准确

性与有效性。

2 Stacking集成学习方法

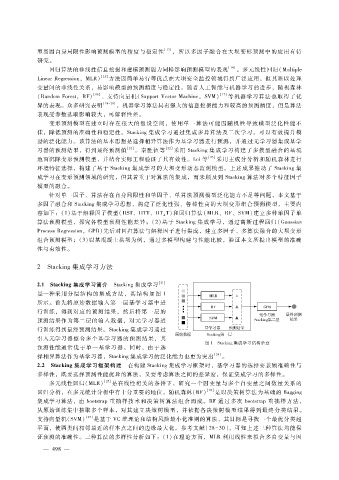

2.1 Stacking集成学习简介 Stacking集成学习 [21]

是一种采用分层结构的集成方法,其结构如图 1

所示。首先将原始数据输入第一层基学习器中进

行训练,得到对应的预测结果,然后将第一层的

预测结果作为第二层的输入数据,对元学习器进

行训练得到最终预测结果。Stacking集成学习通过

引入元学习器整合多个基学习器的预测结果,其

图 1 Stacking集成学习结构示意

预测性能通常优于单一基学习器。同时,由于选

择相异算法作为基学习器,Stacking集成学习的泛化能力也更为突出 [24] 。

2.2 Stacking集成学习框架构建 在构建 Stacking集成学习框架时,基学习器的选择要兼顾准确性与

多样性,既要选择预测性能优异的算法,又要考虑算法之间的差异度,保证集成学习的多样性。

多元线性回归(MLR) [25] 是在线性相关的条件下,研究一个因变量与多个自变量之间数量关系的

回归分析,在多元统计分析中有十分重要的地位。随机森林(RF) [26] 是以决策树算法为基础的 Bagging

集成学习算法,由 bootstrap重抽样技术和决策树算法组合而成。RF通过多次 bootstrap重抽样方法,

从原始训练集中抽取多个样本,对其建立决策树模型,并依据各决策树模型结果得到最终分类结果。

支持向量机(SVM) [27] 是基于 VC维理论和结构风险最小化准则的算法,其目标是寻找一个最优分类超

平面,使两类间相邻最近的样本点之间的边缘最大化。参考文献[ 28 - 30],可知上述三种算法均能保

证预测的准确性。三种算法的多样性分析如下:(1)在理论方面,MLR利用线性来拟合多自变量与因

— 4 9 —

8